Los robotaxis de Waymo ya circulan por las calles de California… y con ellos llega un dilema legal insólito: aunque cometan infracciones, no pueden ser sancionados. El motivo es tan simple como preocupante: los formularios de multa no contemplan un vehículo sin conductor.

El robotaxi que la policía no pudo multar: el vacío legal que deja en jaque a California

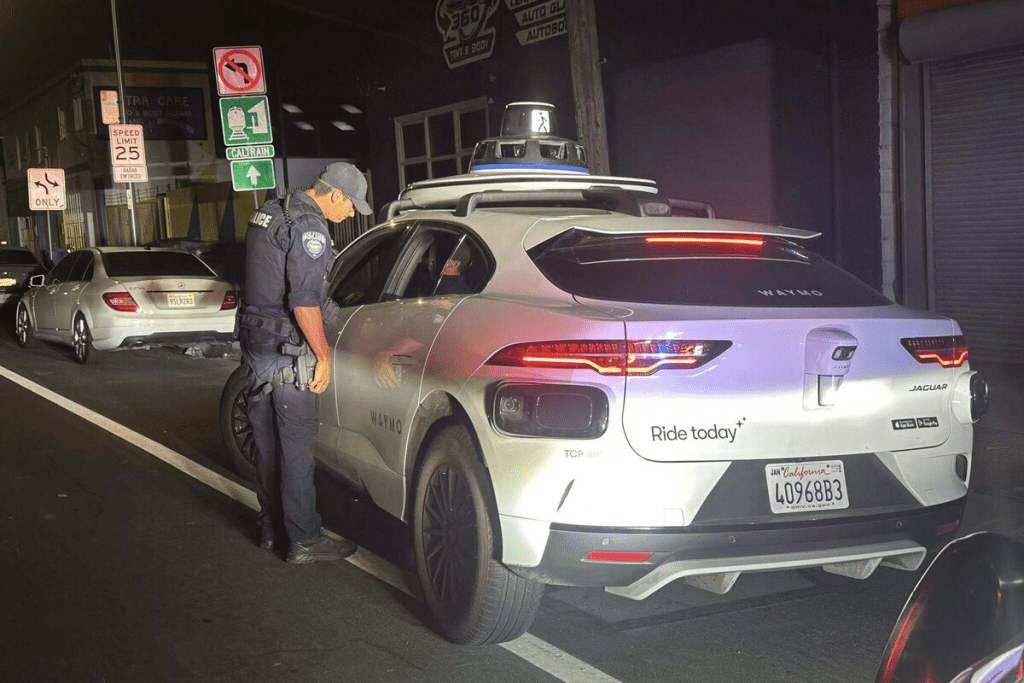

La escena parece sacada de una película de ciencia ficción: la policía de San Bruno (California) detiene un robotaxi de Waymo tras realizar un giro prohibido en un semáforo. Sin embargo, después de unos minutos, los agentes se ven obligados a dejarlo marchar. ¿El motivo? La ley californiana no contempla sancionar a un vehículo sin conductor.

Por qué importa

Lo que podría parecer una anécdota —un simple giro ilegal— revela un vacío legal mucho más grave: ¿quién responde si un coche autónomo causa un accidente mortal?

California permite la circulación de vehículos autónomos desde hace años, pero su código de tráfico sigue anclado en un modelo tradicional. Para multar una infracción se necesita identificar a un conductor responsable, y cuando no hay conductor, simplemente no existe sanción posible.

Los agentes intentaron contactar con Alphabet, la matriz de Waymo, pero no pudieron emitir ninguna citación. “Nuestros formularios de multa no tienen una casilla para ‘robot’”, admitió el departamento de policía en su perfil de Facebook.

Una ley en camino, pero demasiado tarde

Las autoridades han confirmado que se está preparando una legislación para que, a partir de julio de 2026, los agentes puedan emitir avisos directamente a las empresas propietarias de los vehículos. Hasta entonces, los robotaxis circulan prácticamente inmunes a sanciones.

El problema, por tanto, no es técnico, sino político y judicial. Las tecnológicas han desplegado sus flotas más rápido de lo que los legisladores han sido capaces de adaptar las leyes, y esa brecha no solo genera situaciones absurdas, sino que deja desprotegidos a los ciudadanos en casos graves.

La gran pregunta: ¿quién responde?

Si un robotaxi atropella mortalmente a un peatón, ¿quién va a juicio? ¿El algoritmo que tomó la decisión? ¿El ingeniero que lo programó? ¿El CEO de la compañía? Hoy por hoy, nadie tiene la respuesta clara.

Es importante diferenciar entre dos planos:

- Responsabilidad penal: aquí el vacío es enorme, porque el código penal está diseñado para humanos, no para máquinas. ¿Se puede encarcelar a un software? Evidentemente no.

- Responsabilidad civil: la familia de una víctima sí tendría un destinatario legal de su demanda: Waymo, como empresa responsable. En ese caso, el objetivo sería una indemnización millonaria por daños, amparada en conceptos como la responsabilidad por producto defectuoso o la negligencia empresarial.

El verdadero reto, entonces, no es económico, sino cómo adaptar la ley penal a las decisiones autónomas de una máquina.

Un problema global

California es solo el primer escenario visible de este debate. A medida que los coches autónomos se despliegan por Estados Unidos, Europa y Asia, los sistemas jurídicos deberán enfrentarse a la misma pregunta: ¿cómo sancionar a una máquina que no puede declarar, no puede ir a prisión y, técnicamente, no tiene voluntad?

La carrera por regular la movilidad autónoma apenas comienza, y mientras tanto, los robotaxis siguen circulando con un pie en el futuro… y otro en un limbo legal.

Imagen destacada | San Bruno Police Department